Meta presentó Muse Spark, su modelo de inteligencia artificial más potente hasta la fecha. Llegó para repotenciar Meta AI y ya está disponible específicamente en productos de Meta como WhatsApp, Instagram, Facebook, Messenger y en los lentes con IA. En esta nota te explicamos cómo lo puedes usar.

Muse Spark es el primero de una nueva serie de modelos de lenguaje a gran escala creados por Meta Superintelligence Labs. En su

"Muse Spark es el primer modelo de nuestra nueva serie Muse: un enfoque deliberado y científico para escalar modelos, en el que cada generación valida y se basa en la anterior antes de avanzar. Este modelo inicial es compacto y rápido por diseño, pero lo suficientemente capaz como para razonar sobre cuestiones complejas de ciencia, matemáticas y salud. Es una base sólida, y la próxima generación ya está en desarrollo", se lee en la publicación.

¿Qué cambió en Meta AI?

Con Muse Spark la app de

Meta AI y meta.ai se actualizaron el 8 de abril

junto con una nueva apariencia. Ya sea para una respuesta rápida o para ayuda con problemas complejos que requieren razonamiento avanzado, Meta AI ahora puede encargarse de ambos.

Por ejemplo, al planear un viaje familiar a Florida, un agente elabora el itinerario, otro compara Orlando con los Cayos, y un tercero encuentra actividades para niños, todo al mismo tiempo, ofreciendo una respuesta mejor y más rápida.

Lee también:

Cómo funciona Meta AI, el asistente de inteligencia artificial de Facebook e InstagramMeta AI ahora puede entender lo que estás mirando ¿Cómo?

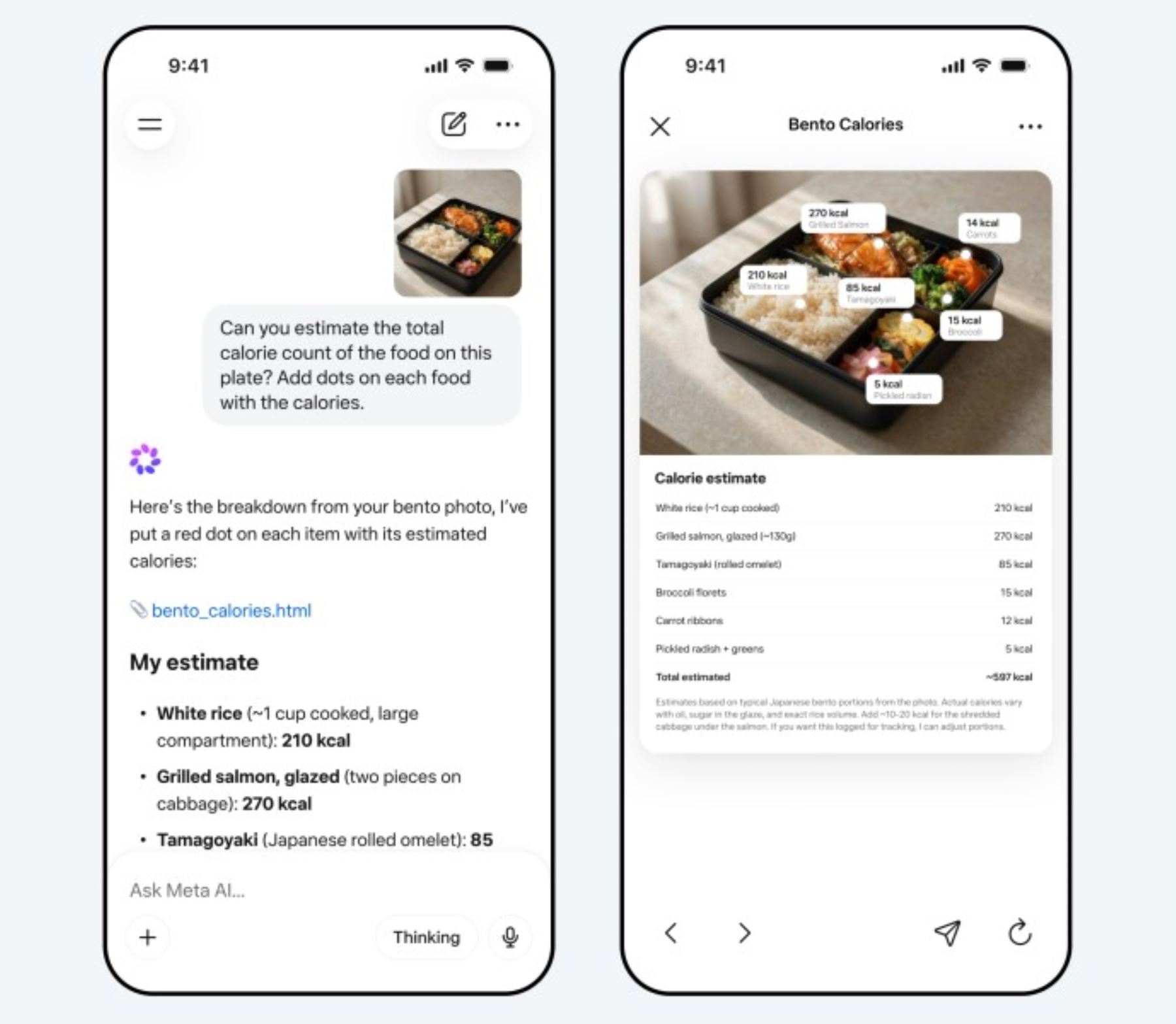

Meta incorporó una sólida capacidad de percepción multimodal en Muse Spark, para que Meta AI pueda ver y entender lo que estás mirando, y no solo leer lo que escribes.

Por ejemplo: Toma una foto del estante de snacks de un aeropuerto y Meta AI puede identificar y clasificar los snacks con más proteína, sin tener que entrecerrar los ojos para leer las etiquetas. Escanea un producto y pregunta cómo se compara con las alternativas.

"Es la diferencia entre una IA que espera que tú le expliques el mundo y una que simplemente mira el mundo contigo. Y cuando Meta AI con Muse Spark llegue a nuestros lentes con IA, el asistente podrá ver y entender mejor el mundo a tu alrededor", señala la empresa tecnológica.

La percepción multimodal es especialmente valiosa para la salud. Con Muse Spark, Meta AI ahora puede ayudarte a orientarte en temas de salud con respuestas más detalladas, incluidas algunas preguntas que involucran imágenes y gráficos.

"La salud es una de las principales razones por las que las personas recurren a la IA, por lo que trabajamos con un equipo de médicos para desarrollar la capacidad del modelo de ofrecer información útil sobre problemas y preocupaciones de salud comunes", explica

Meta.

Meta AI creará minijuegos y también ayudarte en cómo vestir

Muse Spark se destaca en codificación visual, lo que te permite crear sitios web personalizados y minijuegos a partir de una indicación.

Se le puede pedir a Meta AI que cree un panel para planificar una gran fiesta sorpresa, que arme un juego retro de arcade para batir récords, o que lance un divertido simulador de vuelo, y comparte cualquiera de ellos con amigos.

Meta AI ahora puede ayudarte a descubrir qué ponerte, cómo decorar un espacio o qué comprarle a alguien que conoces.

"El modo de compras se basa en la inspiración de estilo y en las narrativas de marca que ya ocurren en nuestras apps, aportando ideas de creadores y comunidades que las personas ya siguen. Y cuando buscas un lugar al que ir o un tema que es tendencia, Meta AI muestra contexto rico y relevante junto a la conversación. Entra a una ubicación y mira publicaciones públicas de personas locales que conocen la zona", detalla Meta.

A medida que se amplíe estas funciones, se espera resultados más ricos y visuales, con Reels, fotos y publicaciones integrados directamente en las respuestas de los usuarios, con el crédito correspondiente a los creadores de contenido.

"A medida que nuestros modelos evolucionen, seguiremos desarrollando medidas para reforzar la seguridad y la privacidad, empezando por el marco de riesgos reforzado y otras protecciones que estamos compartiendo hoy", concluye Meta.

Revisa más noticias sobre

ciencia, tecnología e innovación en la Agencia Andina y escucha historias inspiradoras en

Andina Podcast.

Más en Andina:

(FIN) NDP/MFA