OpenAI anunció mejoras significativas en la capacidad de ChatGPT, específicamente la versión predeterminada GPT-5, para manejar conversaciones sensibles relacionadas con la salud mental, el riesgo de autolesiones y la dependencia emocional.

Este trabajó se realizó con más de 170 expertos en salud mental, como psiquiatras, psicólogos y médicos de atención primaria, que forman parte de the Global Physician Network, con casi 300 profesionales de 60 países.

Las mejoras en la seguridad se centraron en tres áreas clave:

1. Síntomas severos de salud mental (como psicosis y manía).

2. Autolesión y suicidio.

3. Dependencia emocional de la IA.

La IA sugiere descansos ante sesiones prolongadas

Como parte de las intervenciones del producto, OpenAI también amplió el acceso a líneas de crisis, ha redirigido conversaciones sensibles a modelos más seguros, y ha incorporado recordatorios amables para que los usuarios tomen descansos durante sesiones prolongadas.

El modelo fue entrenado para responder de manera segura y enfática a las señales de delirio o manía, y para evitar afirmar creencias infundadas que pudieran relacionarse con angustia emocional o mental.

Hay porcentajes de mejora

OpenAI estima que las recientes actualizaciones han reducido las respuestas que no cumplen plenamente con el comportamiento deseado entre un 65% y un 80% en el tráfico de producción a lo largo de diversos dominios de salud mental.

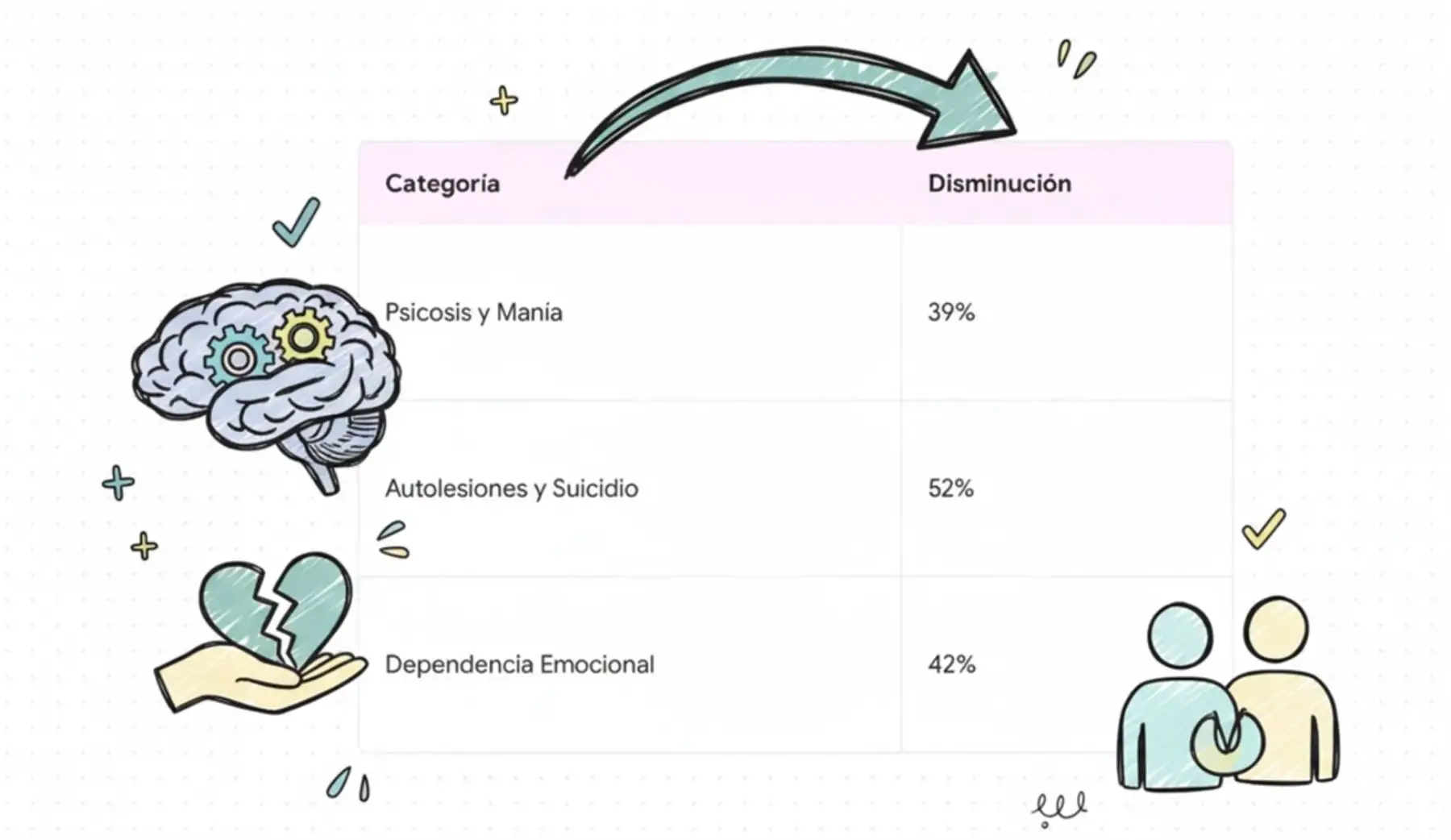

El análisis detallado muestra los siguientes avances en la reducción de respuestas no deseadas:

- Dependencia Emocional del IA: Se observó la mayor mejora, con una reducción de aproximadamente el 80% en la tasa de respuestas del modelo que no cumplen con los comportamientos deseados bajo las taxonomías de dependencia emocional en el tráfico de producción reciente. Los expertos clínicos, en evaluaciones específicas, encontraron una reducción del 42% en respuestas no deseadas en comparación con el modelo GPT-4o.

Lea también: Salud Mental: dónde hay centros comunitarios del Estado y qué servicios ofrecen

- Psicosis, Manía y Síntomas Severos: La última actualización del modelo GPT-5 redujo la tasa de respuestas no conformes en conversaciones relacionadas con problemas de salud mental en un 65% en el tráfico de producción reciente. Los expertos evaluadores observaron una reducción del 39% en las respuestas no deseadas en comparación con GPT-4o.

- Autolesión y Suicidio: Se ha observado una reducción estimada del 65% en la tasa de respuestas del modelo que no cumplen con los comportamientos de seguridad deseados. Los expertos encontraron una reducción del 52% en respuestas no deseadas en este tipo de conversaciones en comparación con GPT-4o.

Es importante señalar que la data de OpenAI y sus mejoras son estimaciones basadas en el tráfico global de ChatGPT.

Como se recuerda, los síntomas de salud mental y la angustia emocional están universalmente presentes en las sociedades humanas, y deben ser diagnosticadas por especialistas.

El objetivo de OpenAI es que ChatGPT reaccione ofreciendo un espacio de apoyo para que las personas procesen sus sentimientos y las guíe a buscar ayuda en la vida real, ya sea con amigos, familiares o profesionales de la salud mental, en lugar de fomentar una dependencia exclusiva de la IA.

La colaboración con profesionales de 60 países asegura que los principios de seguridad busquen reflejar una perspectiva global en la atención de estas complejas situaciones.

(FIN) AMC

JRA

Publicado: 4/11/2025